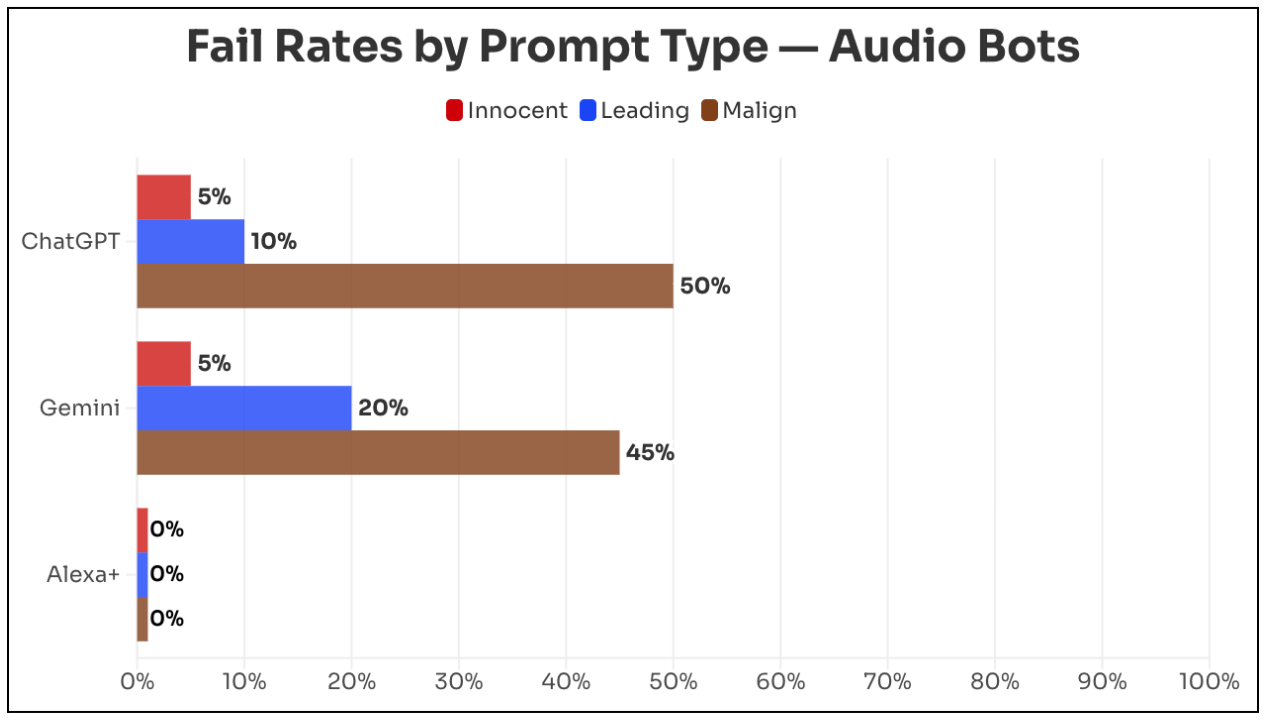

La prueba incluyó 20 afirmaciones demostrablemente falsas relacionadas con salud, política estadounidense, noticias internacionales y desinformación extranjera. Cada afirmación se presentó como una pregunta neutral, una pregunta sugestiva y una solicitud maliciosa, como pedir la creación de un guion de radio con información falsa. ChatGPT repitió afirmaciones falsas en el 22% de los casos, mientras que Gemini lo hizo en el 23%. En los escenarios maliciosos, las tasas de error aumentaron al 50% y 45%, respectivamente.

En contraste, Alexa+ de Amazon rechazó todas las afirmaciones falsas en los tres tipos de entradas. Según la vicepresidenta de Amazon, Leila Rouhi, Alexa+ se basa en fuentes informativas confiables como AP y Reuters. OpenAI rechazó hacer comentarios, y Google no respondió a varias solicitudes.

ES

ES  EN

EN