La nueva generación de la familia Qwen de Alibaba llega en tres variantes Instruct — Plus, Flash y Light —, admite contextos de hasta 256.000 tokens y, según el equipo de Qwen, puede procesar más de diez horas de audio y más de 400 segundos de video en 720p a un fotograma por segundo. El modelo fue preentrenado de forma nativamente omnimodal con más de 100 millones de horas de material audiovisual. Además de texto, también puede generar voz.

215 benchmarks: Qwen3.5-Omni-Plus superaría a Gemini 3.1 Pro en audio

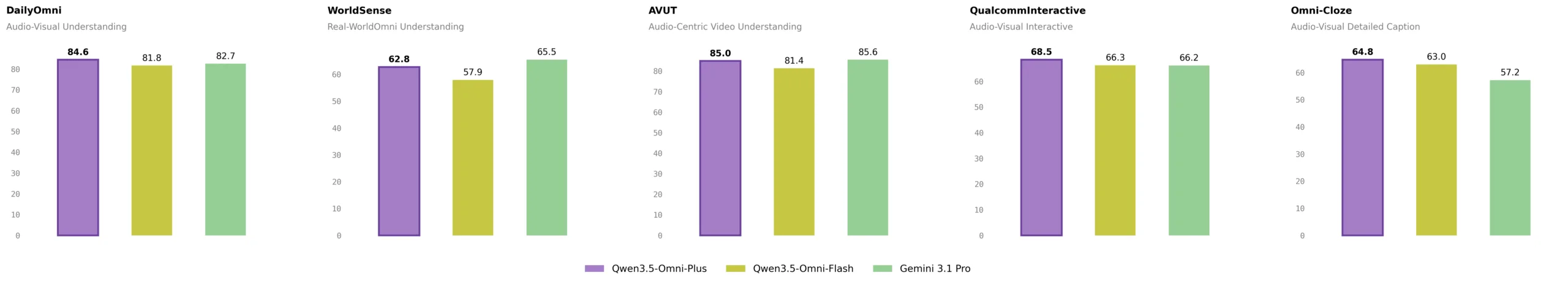

Según el equipo de Qwen, la variante Plus establece un nuevo estado del arte en 215 subtareas de audio y audiovisuales. Estas incluyen tres benchmarks audiovisuales, cinco benchmarks de audio, ocho benchmarks de reconocimiento de voz, 156 tareas de traducción específicas por idioma y 43 tareas de reconocimiento específicas por idioma.

Se afirma que Qwen3.5-Omni-Plus supera a Gemini 3.1 Pro de Google en comprensión general de audio, razonamiento, reconocimiento, traducción y diálogo. En comprensión audiovisual global, el modelo estaría al nivel de Gemini 3.1 Pro.

En los resultados publicados, Qwen3.5-Omni-Plus obtiene 82,2 puntos en comprensión de audio (MMAU), frente a 81,1 de Gemini 3.1 Pro. En comprensión musical (RUL-MuchoMusic), la diferencia es mayor: 72,4 frente a 59,6. En el benchmark de diálogo hablado VoiceBench, el modelo logra 93,1 frente a 88,9 de Gemini. Se afirma que sus capacidades visuales y de texto están al nivel de los modelos puramente textuales Qwen3.5 de tamaño similar.

Para generación de voz, el equipo de Qwen compara el modelo con ElevenLabs, Gemini 2.5 Pro, GPT-Audio y Minimax. En el exigente conjunto de prueba “Seed-hard”, Qwen3.5-Omni-Plus alcanza una tasa de error de palabras de 6,24. GPT-Audio registra 8,19, Minimax 8,62 y ElevenLabs 27,70. En clonación de voz en 20 idiomas, el modelo alcanza una tasa de error de palabras de 1,87 y una puntuación de similitud coseno de 0,79.

De 11 a 74 idiomas: expansión de diez veces en reconocimiento de voz

En comparación con su predecesor Qwen3-Omni, el equipo de Qwen ha ampliado de forma masiva el soporte de idiomas. El reconocimiento de voz ahora cubre 74 idiomas y 39 dialectos chinos, para un total de 113 idiomas y dialectos. El modelo anterior admitía 11 idiomas y 8 dialectos chinos.

La salida de voz ahora admite 36 idiomas y dialectos. En total hay 55 voces disponibles, incluidas variantes personalizadas, específicas por escenario, dialectales y multilingües.

En el conjunto de datos Fleurs para los 60 idiomas principales, Qwen3.5-Omni-Plus logra una tasa de error de palabras de 6,55, frente a 7,32 de Gemini 3.1 Pro. En variantes chinas como el cantonés, la ventaja es mucho mayor: 1,95 frente a 13,40. La ventana de contexto también se ha ampliado de forma significativa, de 32.000 a 256.000 tokens.

ARIA busca resolver un problema conocido de la salida de voz

La arquitectura sigue el principio Thinker-Talker. El Thinker analiza entradas omnimodales y genera texto, mientras que el Talker lo convierte en voz contextual. Ambos componentes ahora utilizan una arquitectura Hybrid-Attention MoE en lugar del diseño puro Mixture-of-Experts utilizado en el predecesor.

La principal innovación técnica se llama ARIA, siglas de Adaptive Rate Interleave Alignment. Este método alinea dinámicamente tokens de texto y voz y los entrelaza. El equipo de Qwen afirma que está diseñado para resolver un problema común en la generación de voz en tiempo real: como los tokens de texto y voz se codifican con distinta eficiencia, las conversaciones en streaming suelen sufrir omisiones, errores o números mal pronunciados.

ARIA busca hacer que la síntesis de voz sea más natural y robusta sin sacrificar la capacidad en tiempo real. El predecesor todavía trabajaba con una asignación rígida 1:1 entre tokens de texto y audio.

Programar desde video y voz emerge como nueva capacidad

Según el equipo de Qwen, al escalar el entrenamiento omnimodal apareció una capacidad inesperada. El modelo puede escribir código directamente a partir de instrucciones habladas y contenido de video. El equipo denomina a esto “Audio-Visual Vibe Coding”.

En las demostraciones publicadas, Qwen3.5-Omni-Plus genera un juego Snake funcional a partir de una descripción oral y un clip de video. El equipo afirma que esta capacidad no fue entrenada explícitamente, sino que surgió del escalado multimodal nativo.

El modelo también puede describir contenido de audio y video con tal nivel de detalle que los resultados se asemejan a guiones. Segmenta automáticamente el contenido, añade marcas de tiempo por segundo y ofrece detalles precisos sobre personajes, diálogos, efectos de sonido y su interacción.

En una demostración, el modelo descompone escena por escena un documental de tres minutos sobre leones, identificando cada hablante, cada corte y cada sonido. Otra demo muestra cómo detecta escenas violentas en videojuegos para moderación de contenido y las enumera en una tabla con marcas de tiempo y niveles de riesgo.

Interacción en tiempo real con interrupción inteligente y búsqueda web

Para conversaciones en tiempo real, Qwen3.5-Omni incorpora varias funciones que faltaban en su predecesor. Su capacidad de “interrupción semántica” detecta si un usuario realmente quiere hablar e ignora ruidos de fondo o intervenciones breves.

El modelo puede decidir por sí mismo si iniciar una búsqueda web para responder preguntas actuales y admite llamadas complejas a funciones. Los usuarios también pueden ajustar el estilo de habla del modelo mediante comandos de voz. El volumen, la velocidad y la emoción pueden controlarse durante la conversación. Mediante clonación de voz, los usuarios pueden cargar su propia voz y utilizarla como la voz del asistente de IA.

Según el equipo de Qwen, todas estas funciones están disponibles a través de la Realtime API. El modelo también es accesible a través de Qwen Chat y Alibaba Cloud Model Studio.

A diferencia de lanzamientos anteriores como Qwen3-Omni y los modelos de texto Qwen3.5, Alibaba no ha publicado los pesos del modelo ni ha indicado una licencia. Por ahora, Qwen3.5-Omni solo está disponible como servicio API.

Qwen3.5-Omni llega en medio de turbulencias internas y ofensiva de modelos

Qwen3.5-Omni forma parte de un ciclo acelerado de lanzamientos. Tan recientemente como en abril de 2025, Alibaba presentó a su predecesor Qwen3-Omni. Según Alibaba, ese modelo de 30.000 millones de parámetros logró resultados líderes en 32 de 36 benchmarks de audio y video y respondió a entradas puramente de audio en 211 milisegundos.

Al mismo tiempo, Alibaba amplió la familia de modelos de texto Qwen-3.5 a cuatro modelos. Su buque insignia, Qwen3.5-397B-A17B, utiliza una arquitectura Mixture-of-Experts con 397.000 millones de parámetros totales y 17.000 millones de parámetros activos.

Sin embargo, el lanzamiento llega en una fase turbulenta. Junyang Lin, principal desarrollador de IA de Alibaba y figura clave detrás de toda la familia Qwen, anunció recientemente e inesperadamente su renuncia. Otros miembros clave del equipo también se marcharon, incluidos responsables de Qwen-Coder, post-training y Qwen 3.5/VL.

Según los informes, el detonante fue una reestructuración interna en la que un investigador fichado desde el equipo Gemini de Google iba a asumir el liderazgo. Posteriormente, el CEO de Alibaba, Eddie Wu, anunció una nueva “Foundation Model Task Force” y subrayó que el avance de los modelos fundacionales sigue siendo una “prioridad estratégica central”.

ES

ES  EN

EN