En comparación, GPT-5.2 Instant a veces producía respuestas que resultaban demasiado cautelosas o excesivamente aleccionadoras al tratar temas sensibles. El modelo actualizado GPT-5.3 Instant ahora recurre mucho menos a ese tipo de advertencias moralizantes.

Al trabajar con información de internet, GPT-5.3 Instant genera respuestas más estructuradas y con mayor sentido. El modelo reconoce mejor el contexto y el significado implícito de una solicitud, al tiempo que contrasta la información encontrada con su propio conocimiento y razonamiento.

En general, el estilo conversacional del nuevo modelo se ha vuelto más natural. Frases innecesarias como “Stop. Take a breath.” prácticamente han desaparecido. La herramienta también presenta menos alucinaciones y rinde mejor en tareas de redacción. Sin embargo, OpenAI advirtió que en algunos idiomas las respuestas aún pueden sonar demasiado literales.

GPT-5.3 Instant ya está disponible para todos los usuarios de ChatGPT y también para desarrolladores a través de la API. El soporte para GPT-5.2 Instant continuará hasta el 3 de junio de 2026.

Alternativa a GitHub

Según varios informes de prensa, OpenAI también está desarrollando una posible alternativa a GitHub. El proyecto aún se encuentra en una fase temprana, pero al parecer ya se ha tomado una decisión estratégica para seguir adelante.

Se espera que el servicio funcione bajo un modelo de suscripción de pago, aunque los periodistas todavía no han revelado más detalles.

Una posible motivación detrás del proyecto son las caídas recurrentes de GitHub, que según se informa han causado dificultades a los ingenieros de OpenAI.

Si OpenAI lanza su propia plataforma para alojar código, se convertiría en un competidor directo de su gran inversor Microsoft, propietario de GitHub.

A finales de febrero, OpenAI recaudó 110.000 millones de dólares con una valoración de 730.000 millones de dólares, lo que convirtió esta ronda en una de las mayores inversiones en la historia de las startups.

Gemini actualizado

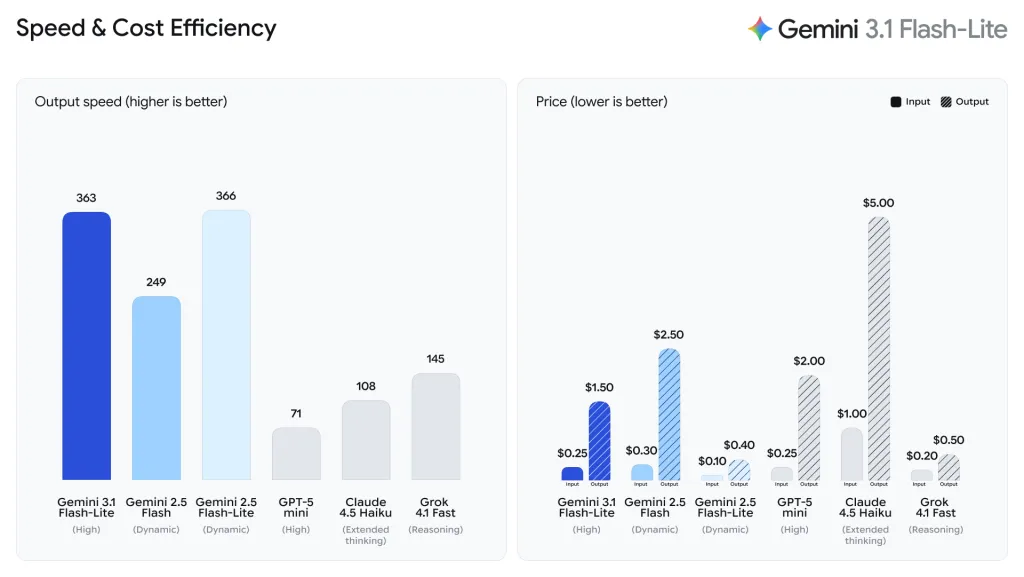

Mientras tanto, Google ha lanzado una versión preliminar de Gemini 3.1 Flash-Lite, descrita como el modelo más económico y rápido de la familia Gemini 3.

El coste de uso del modelo es de 0,25 dólares por millón de tokens de entrada y 1,5 dólares por millón de tokens de salida.

El modelo está optimizado para crear agentes de IA y escalar aplicaciones. Puede encargarse de tareas como traducir grandes volúmenes de datos, moderar contenido y generar interfaces de usuario.

Según investigadores independientes de Artificial Analysis, el nuevo modelo procesa información aproximadamente 2,5 veces más rápido que Gemini Flash 2.5.

Gemini 3.1 Flash-Lite está disponible actualmente en versión preliminar para desarrolladores a través de la API de Gemini y Google AI Studio, y para empresas mediante Vertex AI.

A comienzos de febrero, Google también presentó Gemini 3.1 Pro, un modelo de IA actualizado que estableció nuevos récords en benchmarks.

ES

ES  EN

EN