Por primera vez, Google divide sus Tensor Processing Units en dos líneas separadas: TPU 8t para entrenamiento y TPU 8i para inferencia. Según Amin Vahdat, SVP y Chief Technologist de IA e Infraestructura, este cambio refleja el crecimiento de la demanda de inferencia generada por agentes de IA que planifican, ejecutan y aprenden de forma continua en bucles.

Frente a Nvidia, Google está apostando menos por el rendimiento máximo de cada chip y más por la conectividad a gran escala. The Register señala que las próximas GPU Rubin de Nvidia ofrecerán más potencia de cómputo y mucha más anchura de banda de memoria por chip que la TPU 8t. Pero para entrenar modelos frontier, lo decisivo no es la potencia de un solo chip, sino cuántos pueden conectarse entre sí de forma eficiente.

Y ahí es donde Google parece tener ventaja. Las GPU más recientes de Nvidia pueden conectar hasta 576 aceleradores dentro de un único dominio NVLink antes de tener que recurrir a enlaces más lentos como Ethernet o InfiniBand. Google, en cambio, utiliza conmutadores ópticos de circuito para conectar 9.600 TPU dentro de un solo pod. A través de su nueva Virgo Network, la compañía afirma que varios centros de datos podrán enlazarse en clústeres de hasta un millón de TPU. Una capa de almacenamiento Lustre gestionada envía los datos directamente a la memoria de los aceleradores. Google aspira a una tasa de “goodput” cercana al 97 por ciento, es decir, que los chips pasen casi todo su tiempo entrenando realmente en lugar de esperar checkpoints o recuperarse de fallos.

La TPU 8i, orientada a inferencia, sacrifica parte de la potencia bruta a cambio de más SRAM integrada en chip y una memoria HBM más rápida. Esa SRAM ampliada permite mantener una mayor parte del caché clave-valor —en esencia, la memoria a corto plazo del modelo sobre respuestas anteriores— directamente en el chip, reduciendo los retrasos provocados por el movimiento de datos. Una nueva Collective Acceleration Engine está diseñada para acelerar modelos Mixture-of-Experts, en los que distintos expertos pueden quedar distribuidos de forma impredecible entre varios chips. Google también ha desarrollado una topología de red llamada Boardfly, pensada para reducir la latencia entre chips.

Además, ambas TPU funcionarán por primera vez con las CPU Arm propias de Google, las Axion CPUs.

La plataforma de agentes une desarrollo y despliegue

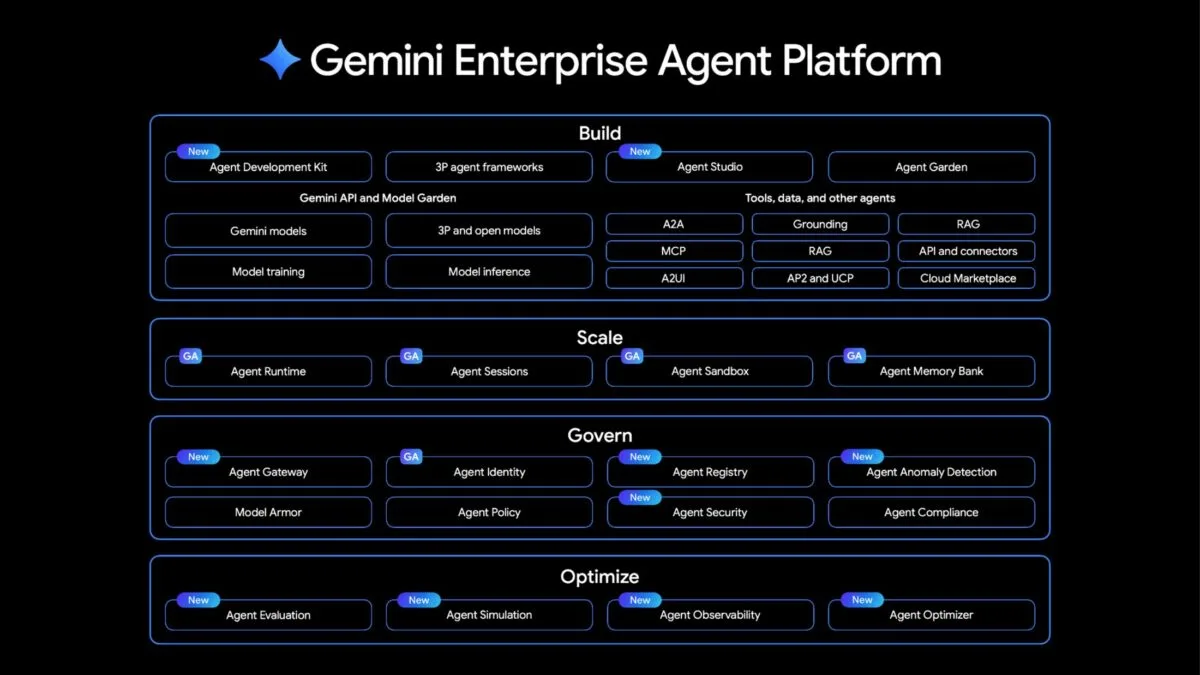

En el plano del software, Google está concentrando sus servicios de IA en la Gemini Enterprise Agent Platform, construida sobre Vertex AI. Para el desarrollo, la plataforma incluye una herramienta que permite a los equipos definir flujos de trabajo multiagente como diagramas de proceso, así como una interfaz llamada Agent Studio, donde los agentes pueden crearse mediante lenguaje natural. Un directorio central busca evitar que las organizaciones acaben con decenas de agentes solapados creados para tareas casi idénticas.

En la fase de despliegue, Google intenta abordar algunas de las debilidades más conocidas de los agentes autónomos. Los agentes de larga duración deberían poder ejecutar procesos de varios pasos por su cuenta, en lugar de esperar aprobación humana en cada etapa. Los entornos de prueba aislados permiten que los agentes ejecuten código que ellos mismos han escrito o realicen automatización de navegador sin poner en riesgo los sistemas anfitriones. Una Memory Bank pretende aportar memoria a largo plazo para que no tengan que empezar desde cero en cada sesión.

Como los agentes autónomos también abren nuevas superficies de ataque, Google añade mecanismos de control: identidades criptográficas para cada agente, filtros contra prompt injection y detección de anomalías para conductas sospechosas, como accesos no autorizados a datos o bucles de razonamiento que no terminan. Las herramientas de simulación permiten probar los agentes frente a interacciones sintéticas antes de exponerlos a clientes reales. La eficacia real de estas protecciones todavía está por verse.

Entre los modelos disponibles figuran Gemini 3.1 Pro, Nano Banana 2 y Lyria 3, junto con Claude Opus, Sonnet y Haiku de Anthropic, además del nuevo Claude Opus 4.7.

La Gemini Enterprise app asociada está orientada a los usuarios finales. Los empleados pueden montar sus propios agentes a partir de bloques modulares, supervisar tareas en curso en una interfaz similar a una bandeja de entrada y editar documentos directamente dentro de la aplicación.

Workspace Intelligence como capa compartida de conocimiento

Al mismo tiempo, Google está lanzando Workspace Intelligence, una capa diseñada para conectar la información de Gmail, Docs, Drive, Meet y Chat. La idea es que Gemini y los agentes construidos sobre esta base entiendan la relación entre correos, reuniones, chats y archivos, en lugar de consultar cada aplicación de forma aislada.

En Gmail, Gemini puede ordenar el correo entrante y resumir temas. En Google Chat, los usuarios pueden crear eventos del calendario o documentos directamente desde una conversación. En Docs, Gemini puede generar borradores a partir de correos y archivos; en Sheets, crear paneles; y en Slides, presentaciones. Drive Projects agrupa archivos y correos en espacios de trabajo organizados por temas. Para los clientes que quieran cambiar de ecosistema, Google también ofrece una migración más rápida desde Microsoft 365.

ES

ES  EN

EN